Google: ecco l'algoritmo che svela i dettagli mancanti dalle foto pixellate

Lo faceva Rick Deckard nel famoso film Blade Runner, ma da oggi lo si potrŕ fare davvero grazie a Google. Grazie alle reti neurali č possibile trasformare immagini praticamente indistinguibili in dettagliate e chiaramente leggibili. Ecco come č possibile.

di Bruno Mucciarelli pubblicata il 11 Febbraio 2017, alle 10:31 nel canale Scienza e tecnologiaL'intelligenza artificiale ancora una volta aiuta l'uomo. Sě perché grazie ad alcune reti neurali, Google, č riuscita ad emulare quello che il famoso poliziotto di Blade Runner, Rick Deckard, faceva durante il film di Ridley Scott. Essenzialmente grazie ad alcuni comandi vocali era possibile, nella pellicola, analizzare uno scatto fotografico nei minimi dettagli zoomando all'inverosimile senza perdere perň qualitŕ nell'immagine. Ebbene tutto questo da oggi potrŕ essere effettuato anche nella realtŕ grazie all'algoritmo che proprio l'azienda di Mountain View č riuscita a realizzare.

Google Brain č il dipartimento per le ricerche sull'intelligenza artificiale ed č proprio da loro che č scaturita l'idea di realizzare un programma che permettesse di rendere leggibile una macchia di colori in una vera e propria immagine dettagliata. Il lavoro che sta dietro a tutto questo č chiaramente enorme ma il suo funzionamento sembra essere, almeno a parole, quasi naturale. Sě perché effettivamente quello che avviene č ciň che in qualche modo viene realizzato dal cervello umano.

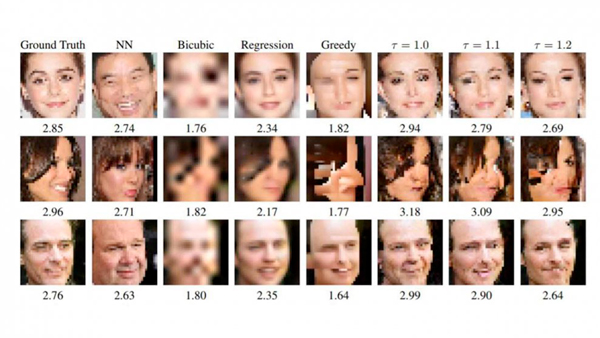

Tecnicamente ci si trova di fronte a due reti neurali che lavorano prima individualmente e poi in simultanea. Ad esse vengono fatte osservare una moltitudine di immagini che ritraggono volti umani e successivamente una rete neurale inizia a confrontare un'immagine pixellata (8x8 pixel) e dunque a bassissima risoluzione con tutte quelle che ha immagazzinato precedentemente. A questo punto entra in gioco la seconda rete neurale che aumenta la risoluzione dell'immagine a 32x32 pixel ma soprattutto inserisce dettagli mancanti. Tutto questo permette di tradurre immagini praticamente illegibili in foto segnaletichedove č possibile riconoscere il volto del soggetto presente.

Insomma il miglioramento e il riconoscimento delle immagini č senza dubbio un settore in cui la tecnologia potrŕ farla da padrona e dove proprio i colossi come Google vogliono mettere mano. Proprio l'azienda di Mountain View non sembra essere la prima a cimentarsi in questo campo visto l'annuncio di Facebook con Lumos, la piattaforma per il riconoscimento delle immagini e dei video. E' chiaro che il lavoro č ancora lungo e tali algoritmi non potranno ancora prendere il posto degli umani ma č chiaro come gli sviluppi dell'intelligenza artificiale potranno permettere buone cose sulla sicurezza e chissŕ magari ai livelli di Blade Runner.

Sony FE 16-25mm F2.8 G: meno zoom, più luce

Sony FE 16-25mm F2.8 G: meno zoom, più luce  Motorola edge 50 Pro: design e display al top, meno il prezzo! Recensione

Motorola edge 50 Pro: design e display al top, meno il prezzo! Recensione Ecovacs Goat G1-800, mettiamo alla prova il robot tagliaerba facile ed efficace

Ecovacs Goat G1-800, mettiamo alla prova il robot tagliaerba facile ed efficace Fire TV Stick a 30€, Echo Show 5 -41%, Echo Dot 39€ (-46%) e molto altro: tornano i super sconti sui dispositivi Amazon!

Fire TV Stick a 30€, Echo Show 5 -41%, Echo Dot 39€ (-46%) e molto altro: tornano i super sconti sui dispositivi Amazon! Motorola moto G84 12GB/256GB a 193€ e G54 8GB/256GB a 144€: affari unici, ecco le differenze fra i due

Motorola moto G84 12GB/256GB a 193€ e G54 8GB/256GB a 144€: affari unici, ecco le differenze fra i due Poche scorte, non perdetevi il super tablet da 109€ con display 10.1" Full HD, 8GB/256GB, LTE e batteria da 8580mAh!

Poche scorte, non perdetevi il super tablet da 109€ con display 10.1" Full HD, 8GB/256GB, LTE e batteria da 8580mAh! Oggi il miglior mini PC è questo: Teclast da 149€ con CPU Intel, 16GB di RAM e SSD da 512GB!

Oggi il miglior mini PC è questo: Teclast da 149€ con CPU Intel, 16GB di RAM e SSD da 512GB! Torna l'Italian Street Photo Festival 2024, lo sponsor principale è Fujifilm Italia

Torna l'Italian Street Photo Festival 2024, lo sponsor principale è Fujifilm Italia Canon CJ27ex7.3B IASE T: l'obiettivo broadcast per registrare video 4K HDR

Canon CJ27ex7.3B IASE T: l'obiettivo broadcast per registrare video 4K HDR PS5 e PS4, parte la promo 'Primavera da Player': giochi in sconto fino al 28 aprile

PS5 e PS4, parte la promo 'Primavera da Player': giochi in sconto fino al 28 aprile Horizon Forbidden West per PC: ecco perché č disponibile solo la tecnologia di Frame Generation di NVIDIA, non quella di AMD

Horizon Forbidden West per PC: ecco perché č disponibile solo la tecnologia di Frame Generation di NVIDIA, non quella di AMD Fallout: che livello ha raggiunto Lucy nella serie TV? Uno youtuber espone i suoi calcoli

Fallout: che livello ha raggiunto Lucy nella serie TV? Uno youtuber espone i suoi calcoli Appian potenzierà il suo Data Fabric con le funzionalità GenAI di AWS

Appian potenzierà il suo Data Fabric con le funzionalità GenAI di AWS Ring celebra il primo compleanno di Ring Intercom alla Milano Design Week 2024

Ring celebra il primo compleanno di Ring Intercom alla Milano Design Week 2024 PS5 Pro: Sony, gli sviluppatori siano pronti entro l'estate e focus sul Ray Tracing

PS5 Pro: Sony, gli sviluppatori siano pronti entro l'estate e focus sul Ray Tracing Amazon Music lancia "Maestro", un nuovo generatore di playlist AI in stile Spotify

Amazon Music lancia "Maestro", un nuovo generatore di playlist AI in stile Spotify Micron, arriva la NAND QLC a 232 layer: prestazioni interessanti per SSD PCIe 4.0

Micron, arriva la NAND QLC a 232 layer: prestazioni interessanti per SSD PCIe 4.0

25 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoSamantha Groves alias "Root" approves this post.

Basta che non si usino i giapponesi come ground truth, non funzionerebbero.

Molto utile!

Discorso completamente diverso se fosse applicato a un filmato dove, pur a bassa risoluzione, utilizzando più fotogrammi dello stesso soggetto (in movimento e/o da angolazioni diverse) è possibile ottenere qualche dettaglio in più. Ma non è questo il caso.

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".